Que sont les algorithmes d'apprentissage machine? Voici comment ils fonctionnent

Added 2018-11-07

L'intelligence artificielle et l'apprentissage automatique sont à l'origine de nombreux progrès constatés dans le secteur des technologies. Mais comment les machines ont-elles la capacité d'apprendre? De plus, comment notre façon de procéder entraîne-t-elle des conséquences inattendues?

Voici notre explication rapide sur le fonctionnement des algorithmes d’apprentissage automatique, avec quelques exemples d’apprentissage automatique qui a mal tourné.

Que sont les algorithmes d'apprentissage machine?

Les programmeurs y parviennent grâce à des algorithmes d'apprentissage automatique. Ces algorithmes sont les modèles sur lesquels est basé un comportement d'apprentissage de l'IA. Les algorithmes, associés aux jeux de données d'apprentissage, permettent à l'IA d'apprendre.

Un algorithme fournit généralement un modèle que l'IA peut utiliser pour résoudre un problème. Par exemple, apprendre à identifier des images de chats par rapport à des chiens. L'IA applique le modèle défini par l'algorithme à un jeu de données incluant des images de chats et de chiens. Au fil du temps, l'IA apprendra à identifier les chats chez les chiens plus facilement et avec précision, sans intervention humaine.

L'apprentissage automatique améliore les technologies telles que les moteurs de recherche, les appareils intelligents pour la maison, les services en ligne et les machines autonomes. C’est ainsi que Netflix sait quels films vous êtes le plus susceptible d’apprécier et comment les services de diffusion de musique en streaming peuvent recommander des listes de lecture.

Mais si l'apprentissage automatique peut rendre notre vie beaucoup plus facile , il peut aussi y avoir des conséquences inattendues.

7 fois où l'apprentissage machine Wentng

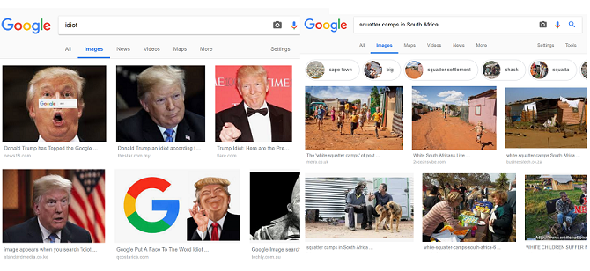

1. Mésaventures dans les résultats de recherche d'images Google

Google Search a beaucoup facilité la navigation sur le Web. L’algorithme du moteur tient compte de divers facteurs lorsqu’il génère des résultats, tels que les mots clés et le taux de rebond. Mais l'algorithme tire également des leçons du trafic des utilisateurs, ce qui peut entraîner des problèmes de qualité des résultats de recherche.

Nulle part cela n’est plus apparent que dans les résultats d’image. Etant donné que les images de pages très fréquentées sont plus susceptibles d’être affichées, les histoires qui attirent un nombre élevé d’utilisateurs, y compris les clickbait, sont souvent classées par ordre de priorité.

Par exemple, les résultats de la recherche d’images pour «camps de squatters en Afrique du Sud» ont suscité la controverse lorsqu’on a découvert qu’il présentait principalement des Sud-Africains blancs. Cela en dépit des statistiques montrant que la grande majorité de ceux qui vivent dans des logements informels, tels que des cabanes, sont des Sud-Africains noirs.

Les facteurs utilisés dans l’algorithme de Google permettent également aux internautes de manipuler les résultats. Par exemple, une campagne d'utilisateurs a influencé les résultats de Google Recherche d'images dans la mesure où la recherche du terme "idiot" affiche des images du président américain Donald Trump.

2. Microsoft Bot transformé en un nazi

Faites confiance à Twitter pour corrompre un chatbot bien intentionné et en apprentissage automatique. C’est ce qui s’est passé dans la journée qui a suivi la publication du célèbre chatbot Tay de Microsoft.

Tay a imité les habitudes linguistiques d'une adolescente et a appris grâce à ses interactions avec d'autres utilisateurs de Twitter. Cependant, elle est devenue l'une des erreurs les plus notoires d'IA lorsqu'elle a commencé à partager des déclarations nazies et des insultes raciales. Il s’est avéré que les trolls avaient utilisé la machine de l’intelligence artificielle pour l’apprentissage, l’inondant d’interactions chargées de bigoterie.

Peu de temps après, Microsoft a mis Tay hors ligne pour de bon.

3. Problèmes de reconnaissance faciale de l'IA

Reconnaissance faciale L'intelligence artificielle fait souvent la manchette pour toutes les mauvaises raisons, telles que des histoires sur la reconnaissance faciale et des problèmes de confidentialité. . Mais cette IA a également suscité de vives inquiétudes lors de la tentative de reconnaissance des personnes de couleur.

En 2015, les utilisateurs ont découvert que Google Photos classait certaines personnes noires dans la catégorie des gorilles. En 2018, l’ACLU a mené une étude qui a montré que le logiciel d’identification de visage Rekognition d’Amazon avait identifié 28 membres du Congrès américain comme des suspects de la police, avec des faux positifs affectant de manière disproportionnée les personnes de couleur.

De son côté, Joy Buolamwini, chercheuse au MIT, se souvient d'avoir souvent eu besoin de porter un masque blanc pour travailler sur la technologie de reconnaissance faciale afin que le logiciel la reconnaisse. Pour résoudre de tels problèmes, Buolamwini et d’autres professionnels de l’informatique attirent l’attention sur ce problème et sur la nécessité de disposer de jeux de données plus inclusifs pour la formation en intelligence artificielle.

4. Deepfakes utilisé pour les canulars

Alors que les gens utilisaient depuis longtemps Photoshop pour créer des images canular, l’apprentissage automatique leur donne une nouvelle dimension. Un logiciel comme FaceApp vous permet d’échanger des sujets d’une vidéo à l’autre.

Pour montrer la puissance de la technologie, le réalisateur Jordan Peele et le PDG de BuzzFeed, Jonah Peretti, ont créé une vidéo deepfake montrant ce qui semble être l'ancien président américain Barack Obama présentant un message d'intérêt public sur le pouvoir de deepfakes.

5. La montée des robots sur Twitter

Les robots Twitter ont été créés à l'origine pour automatiser des tâches telles que les réponses au service clientèle pour les marques. Mais la technologie est maintenant un sujet de préoccupation majeur. En fait, la recherche a estimé que jusqu'à 48 millions d'utilisateurs sur Twitter sont en réalité des robots de l'IA.

Plutôt que de simplement utiliser des algorithmes pour suivre certains hashtags ou répondre aux requêtes des clients, de nombreux comptes de bot tentent d'imiter de vraies personnes. Ces «personnes» font ensuite la promotion des canulars et aident à faire en sorte que les fausses informations deviennent virales.

Une vague de robots Twitter a même influencé l'opinion publique dans une certaine mesure sur le Brexit et l'élection présidentielle américaine de 2016. Twitter elle-même a admis avoir découvert environ 50 000 robots de fabrication russe qui ont publié des articles sur les élections.

Les robots continuent à saccager le service, répandant la désinformation. Le problème est si grave qu’il affecte même la valorisation de la société.

6. Les employés disent qu'Amazon AI a décidé d'embaucher des hommes, c'est mieux

En octobre 2018, Reuters a annoncé qu'Amazon avait dû supprimer un outil de recrutement après que l'IA du logiciel eut décidé que les candidats de sexe masculin avaient une préférence.

Les employés qui souhaitaient rester anonymes sont venus informer Reuters de leur travail sur le projet. Les développeurs souhaitaient que l'IA identifie les meilleurs candidats pour un emploi en fonction de leur CV. Cependant, les personnes impliquées dans le projet ont rapidement remarqué que l'IA pénalisait les candidates. Ils ont expliqué que l'intelligence artificielle utilisait comme base de données de formation les CV de la dernière décennie, provenant pour la plupart d'hommes.

En conséquence, l'IA a commencé à filtrer les CV sur la base du mot clé «femmes». Le mot-clé apparaît dans le CV sous des activités telles que «capitaine de club d’échecs féminin». Alors que les développeurs modifiaient l'intelligence artificielle pour éviter cette pénalisation des CV de femmes, Amazon a finalement abandonné le projet.

7. Contenu inapproprié sur YouTube Kids

YouTube Kids propose de nombreuses vidéos stupides et fantaisistes destinées à divertir les enfants. Mais il y a aussi un problème de vidéos spammées qui manipulent l’algorithme de la plate-forme.

Ces vidéos sont basées sur des tags populaires. Comme les jeunes enfants ne sont pas des téléspectateurs perspicaces, les vidéos indésirables utilisant ces mots-clés attirent des millions de vues. AI génère automatiquement certaines de ces vidéos à l’aide d’éléments d’animation standard, basés sur des tags de tendance. Même lorsque les vidéos sont créées par des animateurs, leurs titres sont spécifiquement générés pour le bourrage de mots clés.

Ces mots-clés permettent de manipuler l’algorithme de YouTube afin qu’ils aboutissent à des recommandations. Une quantité importante de contenu inapproprié est apparue dans les flux des enfants utilisant l'application YouTube Kids. Cela inclut le contenu qui décrit la violence, les sauts et le contenu sexuel.

Pourquoi l'apprentissage machine va mal

Il y a deux raisons majeures à l'apprentissage automatique qui entraîne des conséquences inattendues: les données et les personnes. En termes de données, le mantra de «junk in, junk out» s'applique. Si les données qui alimentent une IA sont limitées, biaisées ou de mauvaise qualité; le résultat est une IA avec une portée ou un biais limité.

Mais même si les programmeurs obtiennent les données exactes, les gens peuvent tout mettre en œuvre. Les créateurs de logiciels ne réalisent souvent pas comment les gens peuvent utiliser la technologie à des fins malveillantes ou à des fins égoïstes. Deepfakes est issu de la technologie utilisée pour améliorer les effets spéciaux au cinéma.

Ce qui vise à fournir des divertissements plus immersifs finit également par ruiner la vie des personnes exploitées.

Des personnes s’emploient à améliorer les garanties autour de la technologie d’apprentissage automatique afin de prévenir les utilisations malveillantes. Mais la technologie est déjà là. De nombreuses entreprises ne font pas preuve de la volonté nécessaire pour empêcher tout abus de ces développements.

Les algorithmes d'apprentissage automatique peuvent nous aider

Cela peut sembler un peu lugubre lorsque vous réalisez à quel point l'apprentissage automatique et l'intelligence artificielle ne répondent pas aux attentes. Mais cela nous aide également de nombreuses manières, non seulement en termes de commodité, mais en améliorant nos vies en général.